网站robots.txt屏蔽网页依旧收录的情况分析

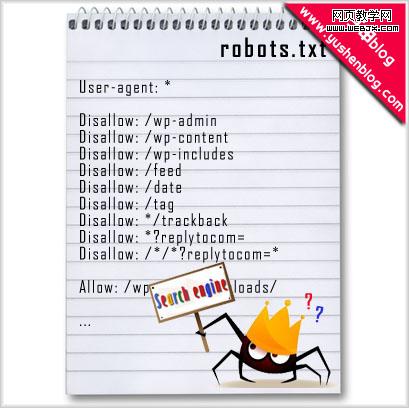

在网站seo优化的过程中常常需要通过一个名为robots.txt的文件与搜索引擎蜘蛛对话。通常来讲,搜索引擎蜘蛛爬行到某一个网站就会首先读取该文件,并按照文件中的规则执行接下来的行为。

当一个网站中有一些网站不需要被搜索引擎收录时,往往就会通过robots.txt来限制搜索引擎蜘蛛对这个网页的抓取。比如说,当网站出现?replytocom重复收录,或者某些不需要被收录并分享权重的页面等等。从这个方面来讲,robots.txt约束了搜索引擎的行为。

而实际情况是,网站在robots.txt禁止了蜘蛛对某个类型url网页的收录,但在用搜索引擎高级命令site查询收录情况是发现,搜索引擎并没有遵从robots.txt中的规则。大部分时候,搜索引擎确实能按照网站robots.txt中所写的规则对这些网页不进行收录。但搜索引擎视robots.txt中的规则为无物的情况也是确实存在的。

当然,也有可能存在网站robots.txt写法出现错误的可能,但此文建立在正确撰写robots.txt的前提下。

有一个很官方的说法是这样的:网站robots.txt中对某个网页屏蔽了蜘蛛的收录,但搜索引擎还是会对该网页进行抓取,只不过在相关搜索结果中不会展现这些网页内容。

这句话咋一看有些令人费解,但据笔者的看法,还是很有可能的。

首先,搜索引擎的发展根本是向搜索用户展现用户所需要的、健康的、优质的内容。在收录并返回相关搜索结果之前,搜索引擎必然要对这些网站进行相应的了解,然后在权衡是否将其收录并给予如何的排名。

打个比方,如果要做一个非法的网站,先假设网站内容没有被监管部门查到,也不考虑以下这个方法的好坏与否。当然,如果直接采用相关的关键词做网站seo优化,在得到更高曝光率的同时也大大增加了被查封的可能性。更何况这些非法内容也不一定不会被搜索引擎屏蔽。

这时,通过大量的健康的内容做网站的seo排名。通过健康的关键词使网站获得大量流量,然后在这些健康的内容上带上非法信息的链接入口。当然,这样的链接必然要使用网站的robots.txt对搜索引擎蜘蛛进行屏蔽,同时将所有的非法内容页面也同样的禁止收录。

难道这样就能既通过搜索引擎谋利,又避开了搜索引擎的监管吗?其实不然,上文中说到搜索引擎为了良好的用户体验,必然会对已收录或者将要收录的网站进行全面的了解(不管现在搜索引擎做的是否完善)。

那好,既然搜索引擎要了解网站,又怎么能对robots.txt中屏蔽的页面视而不见呢?明着对着搜索引擎装纯洁,背地里暗暗的搞一些非法勾当。我想,这种情况搜索引擎不会不考虑到。所以了,即使你的网站robots.txt中明确的对某些页面禁止蜘蛛的爬行,但搜索引擎总还是要“检查”一下的。不然又怎么全面的了解网站的优劣呢?

好吧,要查看网页的情况当然先要抓取进入搜索引擎的服务器,再进行判断了。既然搜索引擎对网站robots.txt中屏蔽的页面还是进行了抓取并查看,那么,又要如何体现robots.txt的作用呢?

那只有将这些页面进行隐藏,至少不能在普通搜索结果中展现出来。不然,网站robots.txt岂不只成摆设?

所以,当发现搜索引擎依旧对网站robots.txt屏蔽的网页进行收录时不用过于紧张。搜索引擎只是想要充分的了解网站情况。但必须要确保robots.txt规则正确书写。一般情况,搜索引擎都会对禁止抓取的网页进行删除,或者说是“隐藏”的。

由于网站robots.txt屏蔽网页依旧收录的情况存在着较大的不确定因素,所以很遗憾笔者无法进行实际的实验对该情况进行检测。同时笔者自认为只是刚刚开始学习seo的菜鸟,所以笔者的观点并不一定正确无误。笔者衷心希望各位seo优化前辈、达人能给予指点和交流,谢谢。

除非特殊注明,本博客文章均为于申原创,版权归于申blog©所有。